大师讲坛回顾 | 国际计算机理论领域泰斗滕尚华教授解码正则化本质

正则化,作为机器学习实践中抑制过拟合、提升泛化能力的利器,其背后的理论根基——“为何正则化能促进学习?它与可学习性的本质关联何在?”——长期悬而未决。

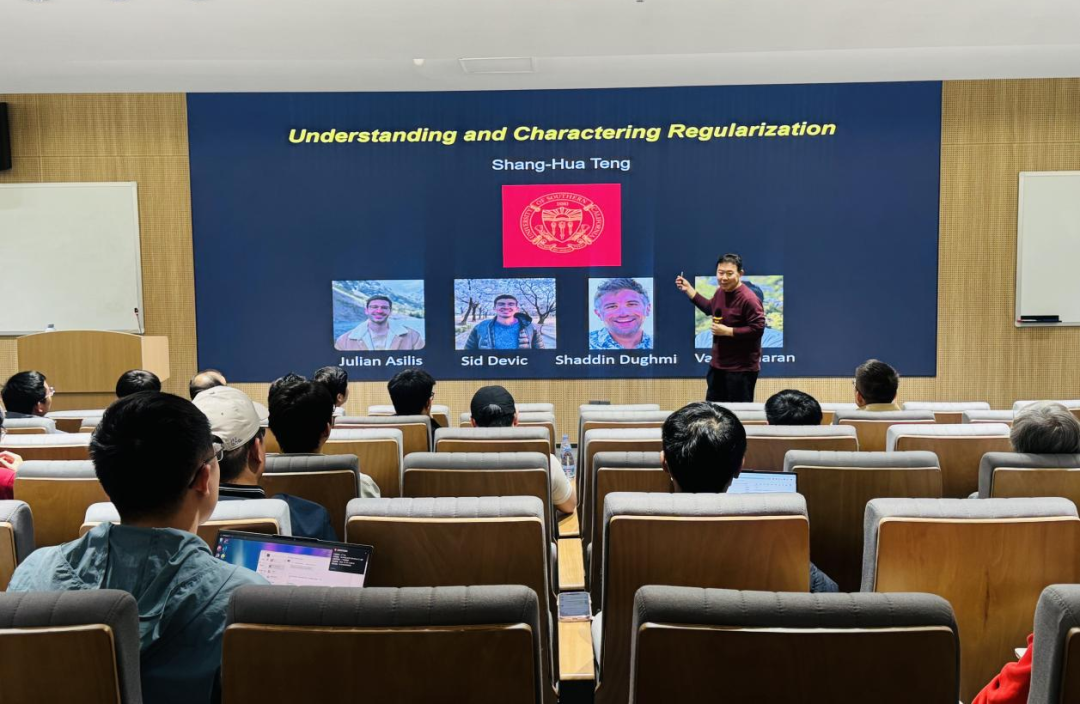

12月23日下午,深圳河套学院特邀国际计算机理论领域泰斗、两届哥德尔奖得主、南加州大学计算机科学与数学教授滕尚华教授做客SLAI Distinguished Semina(大师讲坛),为师生带来题为 “Understanding and Characterizing Regularization” 的学术盛宴。

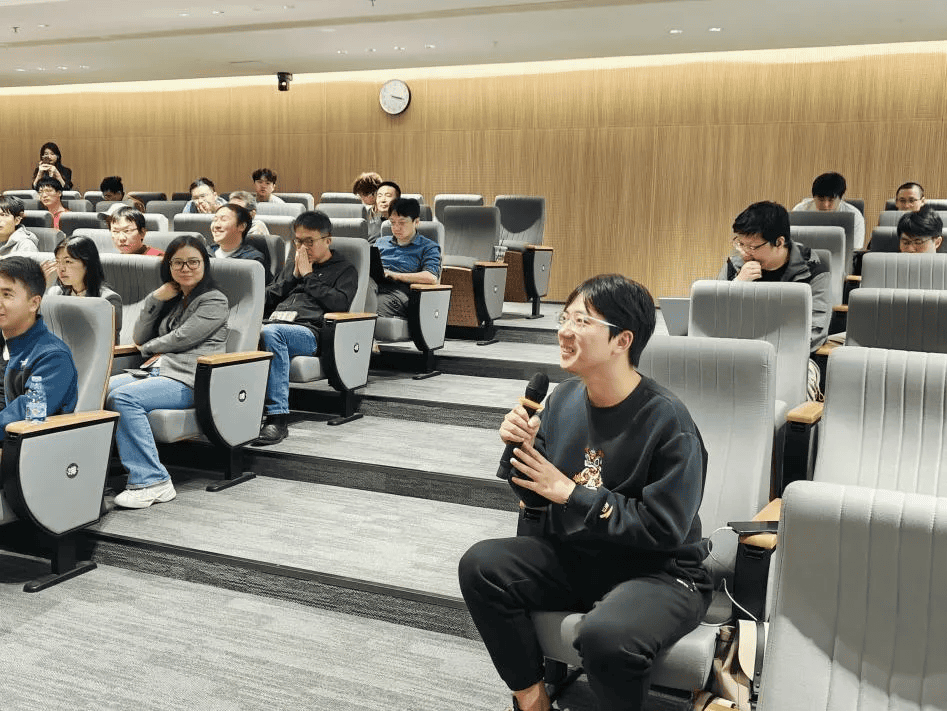

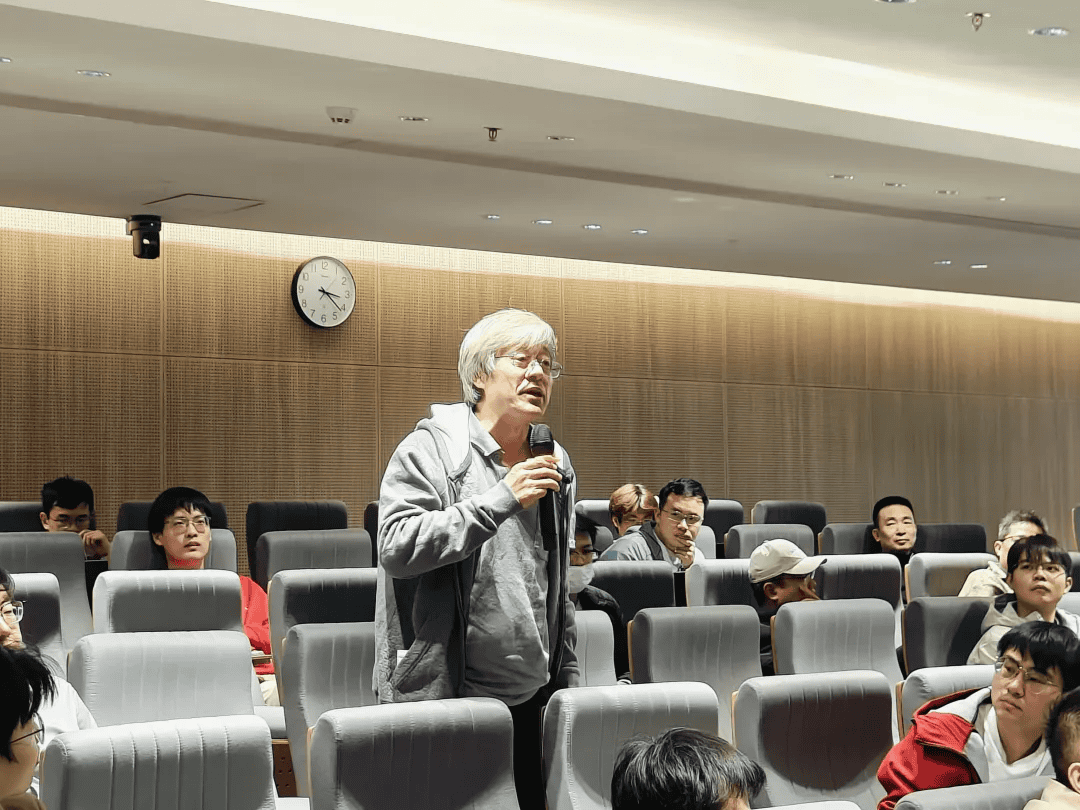

本次讲座聚焦正则化与可学习性之间的深刻数学关联,从一个发人深省的“咖啡馆之问”启程,系统梳理了团队十余年持续迭代的探索路径,并揭示了其与贝叶斯学习、最大熵原理及传导式学习(Transductive Learning)的内在统一视角。现场师生反响热烈,问答环节思维碰撞,气氛活跃。

滕尚华教授的报告直面正则化理论研究的核心挑战:在监督学习框架下,传统以经验风险最小化(ERM)为核心的理解在多类学习等复杂场景中遭遇理论瓶颈。报告旨在回答:是否存在一种更普适的机制,能从根本上阐释正则化的有效性?

起点:“咖啡馆之问”与研究范式的开启

报告始于一个极具启发性的场景:在一次校园散步与咖啡讨论中,一位凸优化方向的青年学者坦言“并非不懂定义,而是不理解正则化如何与可学习性建立严格的数学连接”。这一“知道自己不理解”的时刻,成为研究的起点。

滕教授借此强调科了科研的真谛:真正的突破往往来源于提出可检验的科学问题并勇于不断修正猜想。团队最初提出的愿望性猜想是:

任何可学习的问题,都能通过正则化学习得到。

然而,理论分析很快揭示该猜想在多类学习等情形下并不成立。这一“失败”反而推动研究进入下一阶段:寻找“对正则化做出最小改动,使其变得完备”的机制。

基石:正则化、奥卡姆剃刀与过拟合与过拟合的数学诠释

讲座回归学习的本源:监督学习本质是“通过优化做模型选择”。单纯追求训练数据拟合的 ERM 易引发过拟合,而正则化的核心作用在于引入“拟合误差”与“模型复杂度”的精妙权衡。

滕教授指出,正则化与科学哲学中的奥卡姆剃刀思想相不谋而合——更简约的解释往往更具泛化潜力。但关键挑战在于:如何将这种“简约偏好”在数学上严苛刻画,并使其成为一般学习问题中的充分条件?

突破:传统正则化的边界与“非适当学习”的启示

在经典二分类学习中,“学习即优化”的观念曾一度盛行,认为 ERM 等简单范式足以刻画学习过程。然而,当问题扩展到多类分类或更复杂标签结构时,出现了重要的理论现象:

● 存在一些学习任务无法通过任何“适当学习(proper learning)”完成;

● 标准正则化通常隶属于“适当学习”框架,因此正则化并不普适。

这一理论边界不仅是技术结论,更蕴含教育与认知层面的隐喻:局限于既定范式中“写出同类证明”,有时不足以解决真实问题,研究者需要跳出固定假设空间。

创新:局部正则化与未标注数据的融合—迈向普适学习模版

为突破传统局限,团队尝试提出局部正则化(local regularization):复杂度不仅关联假设本身,更与“要解决的具体任务/数据区域”相关。但深入分析表明,仅靠任务局部信息仍不足以获得普适性。

研究的下一步引入了一个更贴近真实学习流程的要素:未标注数据。在很多应用中,未标注样本远多于标注样本(如邮件、文本与日志等)。滕教授提出新的视角:

未标注数据可以用于“训练正则化器”,让正则化不再仅是人为设计的惩罚项,而是从数据结构中诱导出来。

同时,为使理论刻画更简洁,报告引入随机化学习器(randomized learner):学习算法输出的不只是一个假设,而是一种“在多种策略间随机选择”的分布,从而更自然地连接到贝叶斯更新与最大熵框架。

统一:传统试学习、线性规划对偶、KL散度与最大熵贝叶斯更新

报告以一个生动的“课堂—教材—考试”类比解释传导式学习模型:假设空间像一摞“解题书”,教师选择其中一本作为真规则但不告知;学生先进行“预习”(利用未标注问题结构),再在听课(获得少量标注)后更新判断,最终在考试(预测)时作答。

在该模型中,学习可转化为匹配/可行性的优化问题,并通过线性规划与对偶性得到一组非负对偶变量,可解释为“对教材的先验分布”。当新证据(标注)到来时,通过贝叶斯式更新获得后验,并在预测时按分布抽样决策。滕教授进一步指出:分布更新过程与KL散度(相对熵)紧密相关,而 KL 的局部近似形式自然对应到一种正则化项;最大熵原则则体现为在可行解集合上“尽量少做额外假设”。由此得到核心结论(存在性层面):

利用未标注数据构造的局部正则化 + 随机化学习器,可形成一种完备的学习机制模板。

互动环节中,与会师生围绕实践与理论的前沿议题踊跃提问:从分布漂移与迁移学习的可刻画条件,到多类学习中深度网络为何在经验上“有效但难以被抽象理论完全解释”的追问;从最大熵是否与“简洁偏好”表面矛盾,到散度家族、问题几何与目标函数选择之间更普适的关系;乃至大模型训练效率、BP/梯度法之外的潜在替代路径,以及“先验如何选择、稀疏性何时成立”等关键议题,展开深了深度思辨。

|  |

|  |

滕教授的回应一如既往地彰显其思想的深邃与方法论的严谨自洽:他并未急于给出经验主义式的结论,而是反复引导大家应先澄清问题的结构与假设边界——哪些现象来自“可数到不可数”的集合论跃迁、哪些困难根植于标签空间与表示空间的几何复杂性?哪些经验又可能隐含了实践任务中未被形式化的结构性条件?对于最大熵,他强调其并非“追求复杂”,而是在可行解空间上尽量少施加额外约束,从“假设与解释成本”的角度与奥卡姆剃刀形成对偶式呼应。

正是在这种“把现象还原为可证明的结构、把直觉转化为可检验的框架”的回答方式中,听众不仅获得了对正则化与贝叶斯更新关系的更清晰理解,也深刻体悟到理论工作如何以严格语言为实践经验提供可持续的解释路径。

本次大师讲坛以“正则化的可学习性刻画”为轴线,将一个实践中常用却理论上难以统一解释的概念,与监督学习的基本定义、传导式学习模型、线性规划对偶、贝叶斯更新与最大熵原理的智慧紧密相连,构建了理解正则化乃至学习理论的新范式。

报告不仅呈现了研究结论,更以“从困惑出发、以问题为锚、在试错中迭代逼近真理”的真实研究叙事,生动展现了理论探索的艰辛与魅力。

讲坛尾声,深圳河套学院执行院长罗智泉教授向滕尚华教授致以诚挚谢意。同学们意犹未尽,求知热情不减,纷纷期待与滕教授进行更深入的交流。为此,一场围绕讲座核心议题的小范围探讨紧接着在会议室展开,思想的碰撞持续迸发,将学术探讨的余韵延伸至会场之外。

在经久不息的掌声中,本次思想盛宴圆满落幕,但其激发的思考与启迪,将持续引领SLAI师生在探索智能学习本质的道路上砥砺前行。